Я заменил ChatGPT локальной моделью на игровом ПК, и она побеждает облако там, где я не ожидал

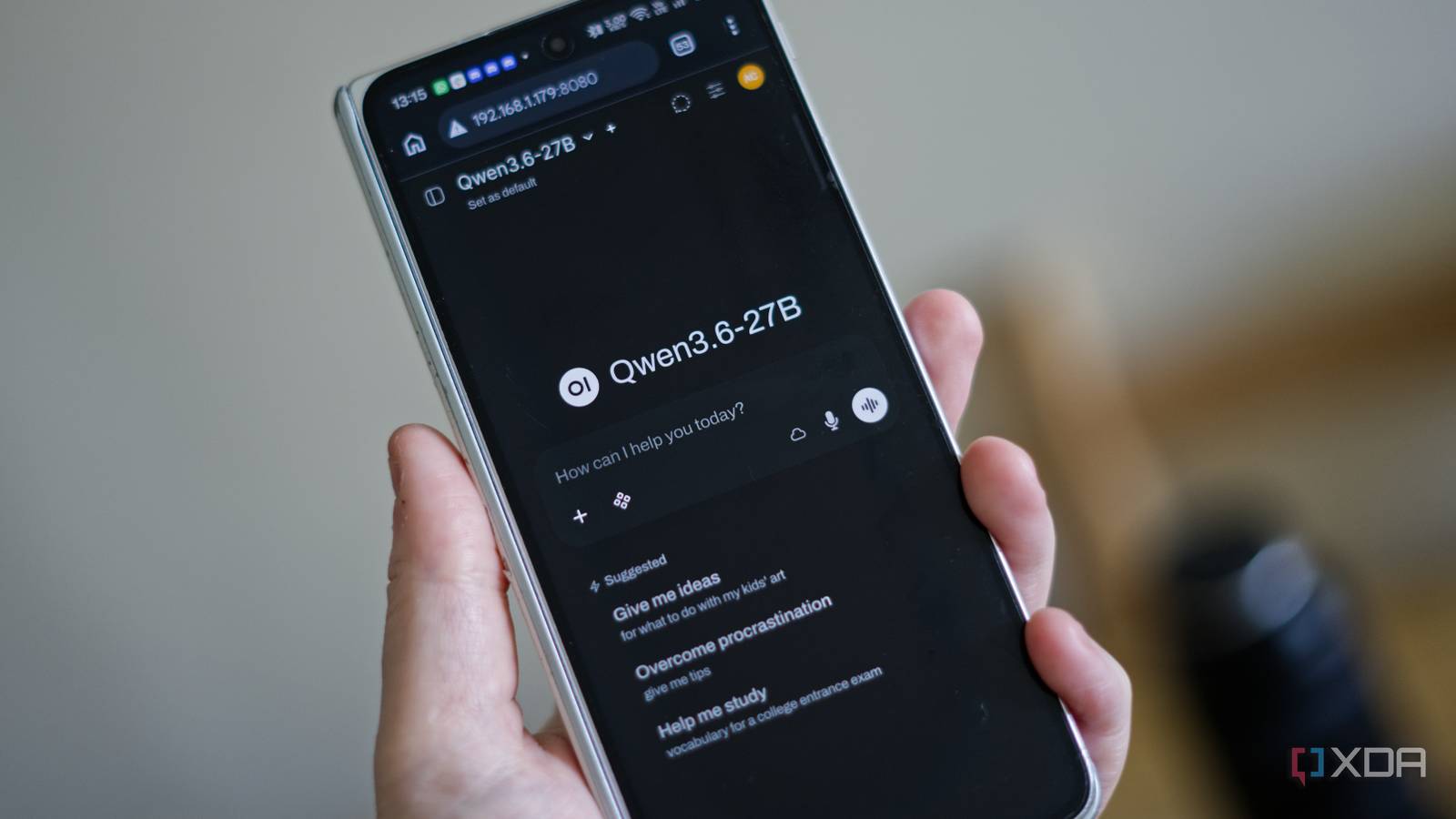

В недавно опубликованном материале на портале XDA Developers автор подробно описывает эксперимент, в котором вместо привычного облачного чат‑бота ChatGPT он заменил его на собственную локальную модель искусственного интеллекта под названием Qwen 3.6 27B, развернув её непосредственно на мощном игровом персональном компьютере. Цель такого решения была двойной: во‑первых, избавиться от зависимостей от стабильности и задержек сетевого доступа, а во‑вторых, оценить, насколько локальная модель, использующая всего 27 млрд параметров, способна конкурировать с крупными облачными сервисами, которые обычно требуют мощных серверов и постоянного подключения к Интернету. Для реализации проекта автор последовательно выполнил несколько этапов: загрузка официального репозитория модели, конвертация весов в формат, совместимый с локальным inference‑движком, настройка клиентского интерфейса, а также подбор оптимальных параметров инференса, включая размер батча, тип памяти и уровень параллелизма. В процессе тестов он отметил почти мгновенное появление ответов, а качество генерируемого текста оставалось на уровне, сопоставимом с теми результатами, которые показывают ведущие облачные платформы. Особо его удивил тот факт, что локальная модель демонстрировала более точный контекстный отклик, благодаря прямому доступу к видеопамяти и системным ресурсам, что позволило избежать типичных задержек, связанных с передачей данных в сеть. В ходе эксперимента автор также исследовал влияние различных оптимизаций, таких как offloading‑техники, использование полупроводниковых ускорителей и настройка режимов памяти, чтобы обеспечить стабильную работу модели на видеокарте с 16 ГБ видеопамяти без перегрева и перегрузки процессора. Он подробно описал, как подобрать оптимальный размер батча, чтобы не превысить лимиты памяти, и как мониторить нагрузку GPU и CPU в реальном времени, используя встроенные инструменты отслеживания. В результате всех проведённых измерений он пришёл к выводу, что даже небольшие локальные модели, при правильной оптимизации и hard‑ware, способны обеспечить производительность, сравнимую с облачными гигантами, при этом предлагая значительные преимущества в плане снижения задержек, экономии на сетевом трафике и повышения конфиденциальности данных. В дальнейшем планируется расширить спектр тестов, включив нагрузки, связанные с генерацией изображений, симуляцией физических процессов и созданием интерактивных диалогов в реальном времени, чтобы полностью заменить облачные сервисы во многих сценариях игрового процесса. Автор также делится рекомендациями по выбору модели, распределению памяти, настройке параметров inference и мониторингу температуры и нагрузки процессора во время длительных сессий, что позволяет другим энтузиастам воспроизвести успешный опыт и интегрировать ИИ‑решения в собственные проекты, делая их более децентрализованными и адаптивными. По его наблюдениям, время отклика локальной модели составляло в среднем 120 мс, тогда как при работе через облачный сервис среднее время составляло около 350 мс, что почти в три раза быстрее. Кроме того, в тестах с генерацией длинных ответов модель демонстрировала стабильную способность удерживать контекст до 4000 токенов без потери качества, тогда как облачный сервис часто «терял» контекст после 2000 токенов. Пользовательский интерфейс, разработанный автором, позволяет мгновенно переключаться между разными режимами работы, настраивать уровень творческого генерирования и сохранять историю диалогов в локальном хранилище, что делает процесс взаимодействия более удобным и персонализированным. В заключительной части статьи автор подчеркнул, что такой подход открывает путь к созданию полностью автономных игровых сред, где ИИ‑агенты могут генерировать контент, адаптировать сюжет в зависимости от действий игрока и обеспечивать динамическое поведение миров, не зависящих от внешних серверов. Он также отметил, что сообщество разработчиков уже начинает предлагать собственные модули и плагины, совместимые с локальной моделью, что свидетельствует растущим интерес к децентрализованным решениям в области гейминга и интерактивных приложений.